2022年12月9日晚,2022人工智能合作与治理国际论坛专题论坛五在线上举办,论坛主题为“人工智能伦理标准”,由慕尼黑工业大学人工智能伦理研究所、清华大学人工智能国际治理研究院、人工智能治理研究中心(清华大学)、中国科协联合国咨商科技伦理与负责任创新专委会共同承办。

慕尼黑工业大学人工智能伦理研究所主任、商业伦理学教授克里斯托夫·吕特格(Christoph Lütge),IEEE标准协会常务理事、IEEE管理委员会委员康斯坦丁诺·卡拉卡琉斯(Konstantinos Karachalios),中国标准化研究院原副总工程师王平,华为英国研发中心研发部总监艾莎·纳西尔(Aisha Naseer),慕尼黑工业大学助理研究员亚历山大·克里比茨(Alexander Kriebitz)、拉斐尔·麦克斯(Raphael Max)及欧尚·博赫(Auxane Boch)应邀出席论坛。论坛上半场由清华大学人工智能国际治理研究院副院长、人工智能治理研究中心(清华大学)主任、清华大学公共管理学院教授梁正主持。下半场由慕尼黑工业大学助理研究员拉斐尔·麦克斯主持。

梁正在开场发言中指出,人工智能作为最具代表性、颠覆性的技术,在给人类带来潜在巨大发展红利的同时,其不确定性也带来很多的挑战甚至引发根本性的伦理关切。伦理问题具有一定的主观性和文化差异性,而标准是对于复杂问题达成一致的解决方案,是实现人工智能治理的重要工具。因此,制定在全球范围内广泛适用且能够落实实施的人工智能伦理标准规范,是在商业和社会层面建立对人工智能技术信任度的关键所在。

梁正主持论坛主旨报告

克里斯托夫·吕特格(Christoph Lütge)做了题为《自动驾驶的伦理》主旨报告。他认为,当前伦理考量远远落后于自动驾驶的发展速度。自动驾驶伦理的关键不是过分强调极端的伦理冲突,而是关注日常生活中的伦理风险,其核心是在自动驾驶汽车轨迹规划中实现风险的公平分配。这需要将伦理标准嵌入到自动驾驶汽车和软件的开发设计中,从而综合多种风险分配原则,选择最公平的分配结果。他进一步提出,德国自动驾驶伦理的标准化体现在德国和欧盟两个层面。其中,德国政府出台了《自动化和互联化驾驶道德准则》和《自动驾驶法案》,实现了德国国内自动驾驶伦理的标准化。2021年4月欧洲委员会提出第一个关于人工智能法律框架的《人工智能法案》,使得所有标准在欧盟国家内实现标准化,无差别地适用于任何一个欧盟国家。具体而言即所有欧盟国家统一用相同标准去划分四个风险等级:最低风险、有限风险、高风险、不可接受风险。在欧盟成员国相互协调的过程中,欧盟在整体上建立起统一和强有力的人工智能领导力。

克里斯托夫·吕特格(Christoph Lütge)做主旨演讲

康斯坦丁诺·卡拉卡琉斯(Konstantinos Karachalios)做了题为《IEEE在人工智能系统中的伦理标准:为实现科技自我治理机制而共同努力》的主旨报告。他认为,要解决人工智能的伦理问题,根本上需要技术人员加强同行交流,形成自我治理机制。当前人工智能发展与各机构对人工智能的治理之间存在鸿沟,每个社会必须承担责任,因而要在文化和地理上采取不同的办法,使全球合作走向平衡。我们无法使全世界都拥有完全一致的伦理标准,而应以更加诚实谦卑的心态,根据每个文明的特性进行调整,做到求同存异;应构建既具共通又有差异性的伦理框架,建立以文化为基础的伦理系统,这种差异应具体表现在解决方案之中,并体现出文化上的灵活性。

康斯坦丁诺·卡拉卡琉斯(Konstantinos Karachalios)做主旨演讲

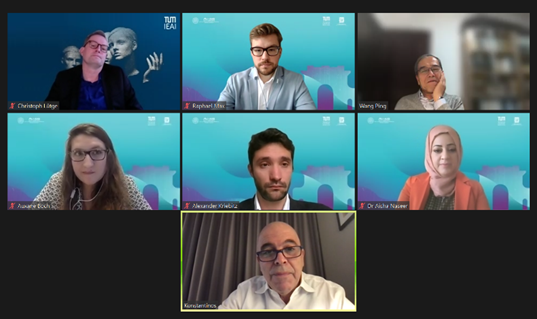

拉斐尔·麦克斯(Raphael Max)主持圆桌对话

在圆桌对话环节,王平指出,标准化在广大企业中落地实施需要从四个方面推进。在法律层面,要采用相应的技术法规,使标准在法律中发挥作用。在合格评定层面,要利用市场机制推动标准化进程。要将复杂任务分解为简单任务,建立简单任务的输出标准和过程标准。要通过算法固化企业标准。王平认为,一个AI企业当没有SDU伦理标准的时候,实际上企业本身也有其伦理标准,而这种标准往往受到资本的驱动。企业应探索良好的行为规范,同时把握好两个维度,一方面不同领域伦理规范具有差异;另一方面在不同文化中也会造成伦理规则的不一致。总之,治理应包括政策维度、法律维度、标准维度、企业标准维度及认证机制等多个维度。

艾莎·纳西尔(Aisha Naseer)认为,人工智能的标准化确实很难在跨国、跨文化和跨行业的背景下实现,因为不同文化、社会和行业对人工智能产品和服务有着不同的需求,这种差异是绝对不能忽视的。但探索通用标准的步伐并未因此而停止,特别是联合国教科文组织公布的《人工智能伦理建议书》,目前已被200多个国家所采用,成为一个被广泛接受的人工智能准则。企业也是如此,华为就尝试在产品和场景层面去实现统一和协同增效,从而提高其在垂直行业中的领导力。最重要的是去建立起一个标准的生态系统,在其中所有相关人都要遵循这个系统的标准,在此基础上再根据不同情景去应用人工智能。

艾莎·纳西尔(Aisha Naseer)发言

亚历山大·克里比茨(Alexander Kriebitz)认为,差异性是人工智能标准化的主要障碍,但又是必须要去面对的问题。不仅需要考虑国家、法律和文化之间的差异,还要关注机构之间的具体差异,有时机构间不同的行为方式和规则反而是造成差异的主要原因。具体而言,人工智能标准化的一个前提就是公平,而差异性有时则会导致人工智能歧视的出现。比如公司使用人工智能进行筛选并雇佣员工时,差异性的设定可能会导致雇佣过程中的歧视。纽约市就推出了一个法案来防止人工智能歧视,使应聘者可以投诉使用人工智能雇佣系统但却没有雇佣他们的公司。解决这些挑战的最佳方法是更主动、更早地在开发和设计过程中设立明确的人工智能标准,以此消除潜在歧视和确保公平性;这需要通过数据框架去提高风险评估和明确用户具体需求的准确率。

亚历山大·克里比茨(Alexander Kriebitz)发言

欧尚·博赫(Auxane Boch)认为,医疗人工智能在标准化方面遇到的挑战更加明显和具体。一方面,人工智能确实出现了一些在不同文化情景下都可以使用的指导原则,这使得跨国家、跨文化的医疗人工智能标准有可能实现。另一方面,在医疗领域的人工智能标准需要做出的调整实在太多,不仅需要根据不同国家的实际条件和法律法规,还要根据不同的文化风俗和宗教进行调整。尊重不同文化和宗教对医疗行为的具体和特定要求显得尤为重要。总之,在通用标准的基础上再根据特定场景和个例需求进行灵活调整,是医疗人工智能标准的核心所在。这需要考虑每一个方面,而不应该指望一个能直接应用于所有环境,适用于每个人的统一标准。

欧尚·博赫(Auxane Boch)发言

集体合影

2022人工智能合作与治理国际论坛由清华大学主办,人工智能国际治理研究院(I-AIIG)承办。大会论坛以“人工智能引领韧性治理与未来科技”为主题,是继2020年“后疫情时代的人工智能国际合作与治理”、2021年“如何构建一个平衡包容的人工智能治理体系”主题的基础上,进一步推动全球各方在人工智能合作与治理方面的对话,旨在更加深入地探讨如何构建适合人工智能健康发展的治理体系,推动建设人类命运共同体。论坛议程为两天,设有三场主论坛、一场特别论坛、七场专题论坛,并举行首届北京人文论坛。活动直播观看人次超700万。